生成AIの世界では「大きいほど良い」という考え方が長らく主流でした。より大きなモデル、より多くのパラメータ、より膨大なデータ量による学習が、より優れたAIを生み出すという考えです。しかし、2025年の現在、新たなトレンドとして「小規模言語モデル(Small Language Model: SLM)」が大きな注目を集めています。

この小規模言語モデルは、特定の用途に特化した軽量なAIモデルであり、これまでの大規模言語モデル(Large Language Model: LLM)とは異なるアプローチで、AI技術の民主化と実用化を加速させています。今回は、この「小さくても強力」なSLMの仕組みやメリット、最新の活用事例について深掘りしていきましょう。

小規模言語モデルとは?LLMとの決定的な違い

SLMとLLMの違いを示す概念図 出典: AIsmiley

SLMは、その名の通り「小規模」な言語モデルです。LLMが数千億から数兆のパラメータを持つのに対し、SLMは数億から数百億程度のパラメータ数で構成されています。しかし、単に「小さい」というだけではなく、実用性を重視した設計思想の違いがあります。

MITテクノロジーレビューが「2025年の世界を変える10大技術」の一つとして選出したSLMは、次のような特徴を持っています:

- 特定タスク向けの最適化: 汎用性よりも特定の用途に特化した優れたパフォーマンスを重視

- 効率的な計算リソース: 限られたリソースでの稼働を可能にする軽量設計

- 学習データの厳選: 膨大なデータ量よりも質の高い特定領域のデータでの学習

従来のLLMが「あらゆることに対応できる万能のAI」を目指したのに対し、SLMは「特定の業務に最適化された専門AI」として設計されています。この発想の転換が、AI技術の新しい活用方法を生み出しています。

小規模言語モデルが注目される4つの理由

1. 開発・運用コストの大幅削減

SLMの最大の魅力は、その経済性にあります。OpenAIのCEO、サム・アルトマン氏によれば、GPT-4の開発には推定で1億ドル以上の費用がかかったとされています。一方、SLMは開発コストを大幅に抑えることができます。

GPT-4oでは100万入力トークンあたり5ドルかかるところ、GPT-4o miniでは同じく0.15ドルと、約30分の1のコストで運用できます。これにより、中小企業や教育機関、個人開発者にも高性能AIの導入が現実的になりました。

2. エッジデバイスでの実行が可能に

エッジAIでのSLM活用例 出典: 東京エレクトロンデバイス

SLMの軽量性は、スマートフォンやIoTデバイスなどのエッジデバイスでの実行を可能にします。クラウドへデータを送信することなく、デバイス上でAI処理が完結するため:

- プライバシー保護の強化

- ネットワーク接続に依存しない安定動作

- リアルタイム処理の実現

- 通信コストの削減

これらのメリットが、オフラインでも高性能なAI機能を提供できる新しいアプリケーションの開発を促進しています。

3. ハルシネーション(幻覚)の低減

LLMの課題の一つに「ハルシネーション」があります。これは、AIが事実ではない情報を自信を持って提示してしまう現象です。SLMは特定領域のデータに絞って学習させることで、この問題を軽減できます。

特に企業の業務システムや医療・金融など、高い正確性が求められる分野では、この特性は非常に重要です。SLMなら、必要な情報に絞ったトレーニングによって、より信頼性の高い応答を期待できるのです。

4. 迅速な学習・更新が可能

SLMはパラメータ数が少ないため、新しいデータでの学習やモデルの更新が迅速に行えます。LLMが数十日から数か月かかる学習プロセスを、SLMでは数日で完了できることも珍しくありません。

これにより、最新情報への対応や、特定業務に合わせたファインチューニングが容易になり、AIの実用性が大きく向上します。

注目の小規模言語モデル最前線

Microsoft Phi-3:小さくても大きな可能性

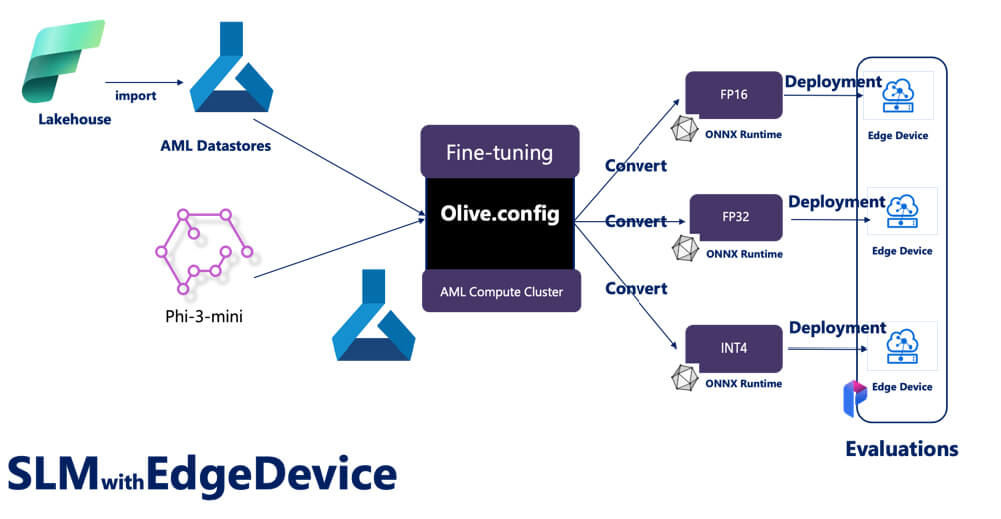

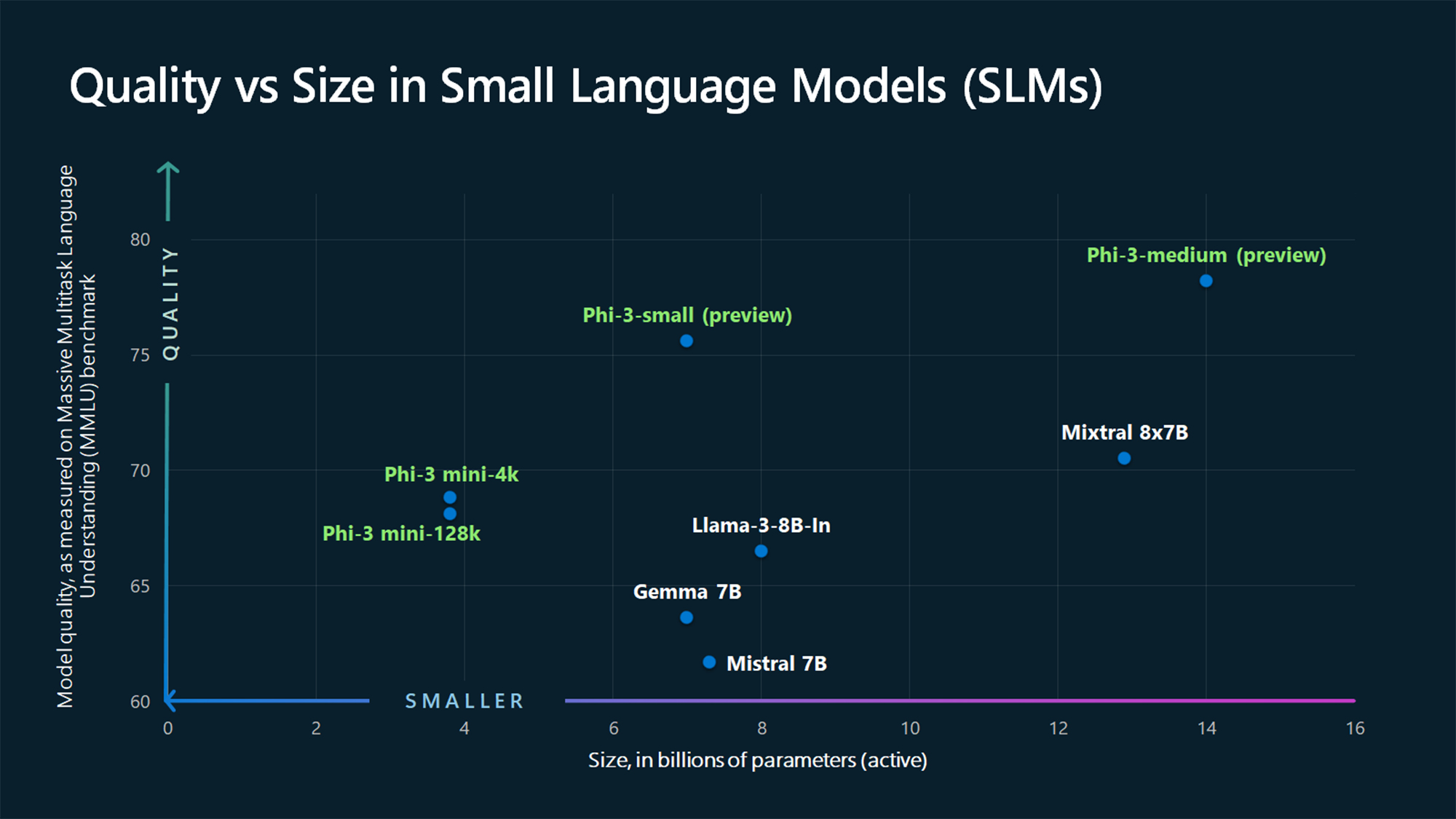

Microsoft Phi-3シリーズ 出典: Microsoft News

Microsoftの小規模言語モデル「Phi-3」シリーズは、SLMの可能性を示す代表例です。Phi-3 miniは38億パラメータという小規模ながら、特定タスクではパラメータ数が70億のLlamaなど、より大きなモデルに匹敵する性能を発揮します。

Phi-3シリーズの特徴は:

- 無料で商用利用可能なモデル提供

- mini(38億)、small(70億)、medium(140億)の3サイズ展開

- マルチモーダル(テキスト+画像)対応のvisionモデル

- 特化型トレーニングによる高効率学習

特に、エッジデバイスでの実行を念頭に置いた設計思想は、SLMの利点を最大限に活かしています。

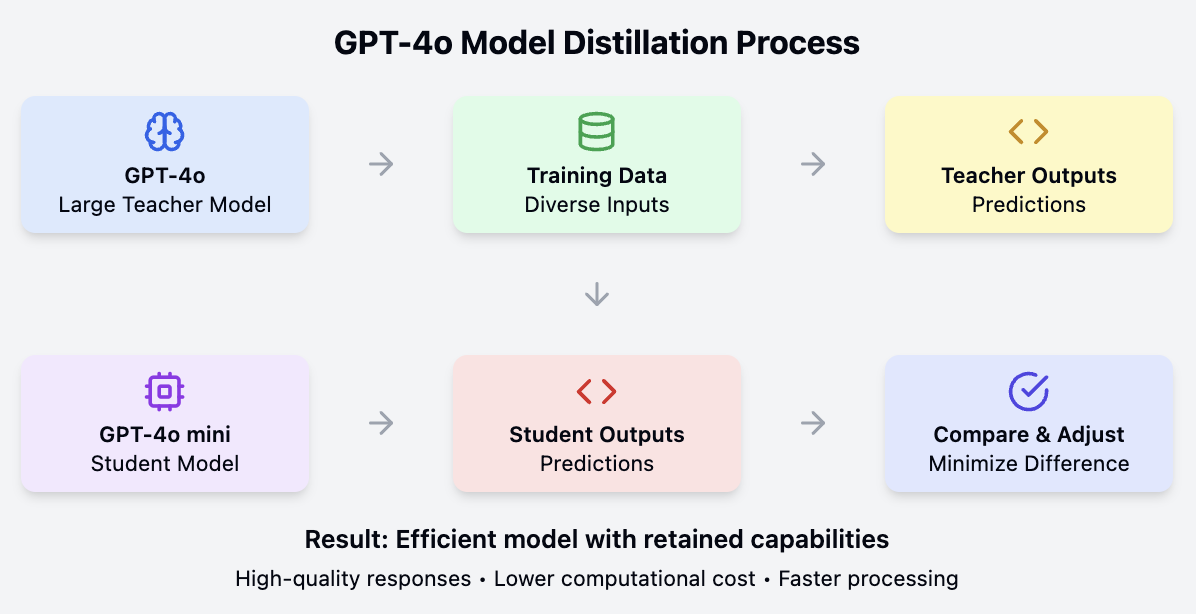

OpenAI GPT-4o mini:低コストで高性能を実現

GPT-4o miniのパフォーマンス 出典: DataCamp

OpenAIも2024年7月に小型モデル「GPT-4o mini」をリリースし、SLM市場への本格参入を果たしました。GPT-4o miniは軽量化と高速性に重点を置き、GPT-3.5 Turboを上回る性能を実現しながらも、GPT-4oの約30分の1のコストで利用できる点が特徴です。

GPT-4o miniの強み:

- 費用対効果の高さ(100万トークンあたり0.15ドル)

- 数学的推論とコーディングタスクにおける高性能

- 12.8万トークンのコンテキストウィンドウ

- 迅速な応答速度

企業のチャットボット導入や業務自動化において、コストパフォーマンスに優れたモデルとして注目されています。

その他の注目SLMモデル

- Google Gemma 7B: Google DeepMindが開発した7億パラメータのオープンソースモデル

- Mistral 7B: 商用利用可能な高性能SLMとして人気

- TinyLlama: わずか11億パラメータの超軽量モデル

- Stable LM 2 1.6B: 多言語対応の16億パラメータモデル

SLMの実用事例:ニッチな領域で力を発揮

金融業界での活用

金融機関では、融資審査プロセスにSLMを導入する例が増えています。融資申請書や財務諸表など専門的な文書の分析に特化したSLMは、審査業務の効率化と公平性の向上に貢献しています。

特に、金融特有の専門用語や規制に関する深い知識が必要な分野では、汎用LLMよりも専門性の高いSLMが優れた結果を出せるケースが多いのです。

法務分野での契約書レビュー自動化

法律事務所では契約書のレビューに多くの時間と専門知識を要します。SLMを活用することで、契約書の分析や潜在的リスクの検出を半自動化し、弁護士の業務効率を大幅に向上させることができます。

法的文書に特化して学習させたSLMは、一般的な契約条項の分析や標準的な修正提案を高精度で行えるようになっています。

オフラインでも使えるAIアシスタント

インターネット接続が不安定な環境や、セキュリティ上の理由でクラウドAIを利用できない場所でも、SLMならローカルデバイス上で動作するAIアシスタントを実現できます。

医療現場での患者データ分析や、秘匿性の高い研究開発現場での情報処理など、データを外部に送信したくないケースでは、オンデバイスで完結するSLMの価値が特に高まります。

SLM導入における課題と限界

SLMの魅力的な特性と同時に、いくつかの課題や限界も認識しておく必要があります:

- 汎用性の低さ: 特定分野に特化していることは強みである一方、幅広いタスクへの対応には向いていません

- データ収集の難しさ: 特定分野の質の高いデータセットを構築するのは容易ではありません

- 専門知識の必要性: 最適なSLMの設計・実装には、対象領域の深い理解が求められます

これらの課題にもかかわらず、SLMの利点を活かした実用展開は急速に広がっています。

小規模言語モデルが切り開く未来

SLMの登場は、AIの「大きさ競争」から「効率性競争」へのパラダイムシフトを象徴しています。MITテクノロジーレビューが指摘するように、「次のブームは小規模」なのです。

特に、スマートシティやIoT、ウェアラブルデバイスなど、エッジコンピューティングの成長とともに、SLMの重要性はさらに高まると予想されます。また、エネルギー消費量の少なさはカーボンニュートラル時代におけるAI運用の持続可能性の面からも注目されています。

今後は、大規模モデルと小規模モデルを組み合わせたハイブリッドアプローチや、特定用途に最適化された超小型モデルの開発がさらに進むでしょう。企業は自社の課題に最適なAIソリューションを選ぶために、SLMとLLMの特性を理解し、使い分けていくことが求められています。

まとめ:AIの民主化と実用性向上への道

小規模言語モデル(SLM)の台頭は、「より大きく」ではなく「より賢く」というAI開発の新潮流を示しています。開発コストの削減、エッジデバイスでの実行、ハルシネーションの低減、迅速な学習・更新といった特長は、より多くの組織がAIを活用するための障壁を大きく下げています。

特定の業務や分野に特化したAIが、クラウドに依存せず、低コストで導入できるようになることで、生成AIの実用展開は新たなステージへと進化しつつあります。大規模なリソースを持つ企業だけでなく、中小企業や個人開発者も含め、誰もがAI技術の恩恵を受けられる時代がついに到来したのです。

SLMの進化は始まったばかりです。今後も注目のテクノロジーとして、その発展と活用事例の広がりから目が離せません。

コメント